Es un ritual como cualquier otro. Antes de acabar cada año, se multiplican las predicciones para el siguiente. Entre las empresas que recurren a esa táctica para que se hable de ellas, IBM hace algo distinto: en vez de un pronóstico a doce meses, publica su informe 5in5, una visión del futuro de la tecnología en el horizonte de cinco años. En la edición 2012, los autores han preferido un discurso diferente al de otros años: los dispositivos digitales del 2017 serán capaces de complementar, y en cierta medida de emular, los cinco sentidos de que está dotado el ser humano: tacto, vista, oído, gusto y olfato. En el trasfondo, lo que IBM denomina sistemas cognoscitivos.

No es que IBM tenga una bola de cristal, sino que sus investigadores han recopilado hipótesis, sin duda ambiciosas, que, en la práctica, no son sino proyecciones de fenómenos observables hoy. Un ejemplo: se atribuye a los móviles del 2017 la capacidad de actuar como front-end de sistemas inteligentes, gracias a que estarán equipados con sensores, pero esta posibilidad está implícita en la evolución de los actuales.

La secuencia de los informes 5 in 5 se origina en 2006, y nadie exigirá que sus pronósticos se cumplan al pie de la letra y en el plazo previsto, siempre que sean consistentes con las tendencias de la tecnología y la sociedad. En la primera edición se planteaba que la medicina dispondría en 2011 de medios de diagnóstico remoto a través de dispositivos móviles, y se ha cumplido [ciertamente no anywhere in the world, como se decía]. Otra hipótesis, las imágenes 3D en Internet, no parece que haya sacudido el ritmo de desarrollo de las redes que serían necesarias para llevar la idea a la práctica.

Bernard Meyerson, Chief Innovation Chief de IBM, introduce así las tesis del estudio: «desde mi punto de vista, los sistemas cognoscitivos nos van a ayudar a superar las límitaciones de nuestro ´ancho de banda` humano. Los sensores, acoplados con motores analíticos, extenderán nuestra capacidad para reunir y procesar la información recogida por nuestros cinco sentidos». Por tanto, ¿qué implicará esta capacidad para el mundo real en el que se desenvuelven los individuos de la especie humana?

Tacto: según el estudio, es posible imaginar el día en que puedan tener la percepción táctil de una tela en la pantalla de un móvil. Más que imaginar, los científicos de IBM ya desarrollan prototipos de aplicaciones para el comercio minorista y otros sectores, basadas en tecnologías sensibles al tacto y la vibración. En lugar de sugerir que los ordenadores sean capaces de ´comprender` la sensación táctil, será el usuario quien incorpore esa sensación al tocar la superficie de la pantalla.

De momento, el interés práctico de la innovación parece enfocado a la simulación del tacto de una tela antes del acto de compra; una de las ventajas de esta primera proposición es que parece corresponder a unos conocimientos y tecnología existentes, lo que la convierte en la más viable de las cinco, al menos en apariencia.

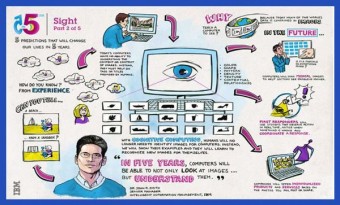

Vista: todos los dispositivos tendrán una capacidad de ´comprensión` del contenido de las imágenes. Esto ha comenzado con ciertas funciones de Facebook o los sistemas de reconocimiento facial usados por las fuerzas de seguridad para interpretar imágenes tomadas por cámaras de vigilancia. IBM considera que el siguiente paso podría darse en sistemas médicos, para que un profesional pueda analizar las imágenes obtenidas por resonancia mágnetica, rayos X o ultrasonido.

A priori, si algo tan corriente como una cámara autofocus puede comparar un rostro con otro, no parece difícil, pero según los científicos de IBM sólo un sistema cognoscitivo podría reconocer los elementos de una foto o un vídeo en tiempo real, una cualidad que el ojo humano no tiene. Los sistemas de visión artificial pueden ser ´entrenados` para capturar imágenes y, gracias a ello, alertar a las autoridades en casos de emergencia o problemas de seguridad.

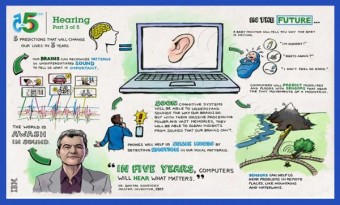

Oído: un sistema distribuído de sensores podría detectar la presión y vibración de las ondas de sonido en distintas frecuencias. ¿Para qué? Un ejemplo que aparece en el informe 5 in 5 es la identificación temprana del riesgo de caída de un árbol o de un deslizamiento de tierras, antes de que se materialicen con el consiguiente peligro. Igualmente, por ahora en teoría, una forma específica de reconocimiento de voz permitiría saber por el llanto si un bebé tiene hambre, calor o dolor.

IBM contempla la posibilidad de otros usos como asistentes virtuales, como la identificación de debilidades estructurales en un edificio, que podrían alertar del riesgo de derrumbe. Un proyecto llamado Deep Thumder utiliza datos de audio (y otras fuentes) para estudios meteorológicos ´hiperlocales` en áreas inundables de Brasil.

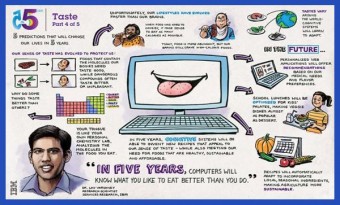

Gusto: se diría que el gusto es el único de los sentidos exclusivamente humano, pero los laboratorios de IBM experimentan con la desagregción de ingredientes hasta su base molecular para luego combinar la química de esas moléculas y cruzarla con el conocimiento de la psicología relacionada con los sabores. Analizar cómo interactúan químicamente los componentes de un alimento – y cómo los perciben los humanos – tendría interés práctico más allá de la «cocina creativa».

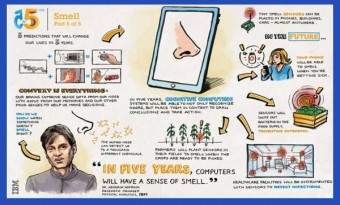

Olfato: es el pronóstico más sorprendente, pero su principio básico no está alejado del anterior. En el ejemplo publicado, diminutos sensores podrían permitir que un smartphone detecte si el usuario está constipado, mediante el análisis de biomarcadores relacionados con el aliento. Llevando la hipótesis a otros campos, un ordenador podría analizar la ´firma` química del aire, una superficie o un objeto, para determinar – es otro ejemplo – si un área hospitalaria es estéril.

Naturalmente, los ejemplos seleccionados por los autores tratan de poner de relieve las aplicaciones potenciales más cercanas a la vida cotidiana. En la práctica, las predicciones para el 2017 se apoyan en la evolución esperada de las tecnologías de sensores pero, sobre todo, desembocan en el modo de interpretar la información recogida. Es aquí donde el estudio permite a la compañía presumir de sus avances en materia de sistemas cognosctivos, un campo que aplica conceptos procedentes de la neurobiología, relacionados con el modo en que los sentidos humanos procesan la información y el cerebro desarrolla habilidades relacionadas con esa información.

Aunque emparentada con los trabajos sobre inteligencia artificial, se trata de otra disciplina: la idea no es crear una de esas máquinas «inteligentes» que sólo existen – generalmente controladas por villanos – en las obras de ciencia ficción. Los ordenadores DeepBlue – aquel que derrotó a Kasparov – o Watson, que ganó un concurso de la tele, sólo son hitos en la búsqueda de sistemas cognoscitivos.

Trata Meyerson en su introducción de deshacer un equivoco potencial: «no tenemos como objetivo replicar el cerebro humano, porque no necesitamos una réplica; tampoco se trata de reemplazar el pensamiento humano tratando de que las máquinas piensen». En su lugar, explica, «la era de los sistemas cognoscitivos supone que los humanos y las máquinas colaboren para producir mejores resultados, aportando cada parte aquello en lo que sea superior. Las máquinas serán más racionales y analíticas; los humanos pondremos la empatía, la brújula moral y la creatividad».