Quede claro que Google Cloud sigue creciendo en edad y estatura, pero sin romper su dependencia económica de la matriz, Alphabet. Cuando se leen las cifras, salta a la vista que en el primer trimestre de 2021, sus ingresos sumaron 4.047 millones de dólares, un impetuoso salto del 46% interanual, pero arrastra números rojos: 974 millones de pérdidas operativas, con las que bien puede conformarse ya que un año antes fueron 1.734 millones negativos. No es que sea peccata minuta, pero Alphabet se lo puede permitir, gracias a sus 55.000 millones de ingresos y 18.000 millones de beneficio (un 162% de incremento]. Eso sí, tratando de hacer poco ruido para no alertar a los vigilantes.

Y antes de seguir, conviene precisar que el agregado Google Cloud – así aparece en las cuentas – incluye un núcleo duro, Google Cloud Platform (GCP), que será el asunto de esta crónica, y uno secundario rebautizado Workspace, anteriormente conocida como G-Suite. En la conferencia de mayo con analistas bursátiles, Sundar Pichai, CEO de Alphabet, dejó constancia pública de su satisfacción con la marcha de GCP, al subrayar que “su ratio de crecimiento de ingresos ha sido, una vez más, significativamente superior a la del mercado cloud”.

Sólo un mes antes, Pichai había pregonado que este año el grupo invertirá 7.000 millones de dólares en nuevos centros de datos que incrementarán las capacidades de GCP. Adicionalmente, se espera que un 30% de las contrataciones de personal tendrán como objetivo aumentar la plantilla de esta actividad. Ante varias preguntas, la CFO Ruth Porat – vista como custodia de la disciplina financiera del holding – se pronunció inequívocamente de acuerdo. “Nuestro enfoque no ha cambiado – dijo – ya que vamos a reforzar el crecimiento de los ingresos y para esto seguiremos invirtiendo agresivamente [en el adverbio está la clave] para aprovechar cada oportunidad que se presente”.

Como consecuencia, los analistas se dieron prisa a informar a sus inversores que ven muy fácil que Google Cloud cierre el año fiscal 2021 con ingresos de 18.000 millones o más (un 38% de aumento); en fin, que sería mucho dinero pero no tanto si se compara con los 75.000 millones que prevén para Azure y los más de 60.000 millones de AWS, según proyecciones de los mismos analistas.

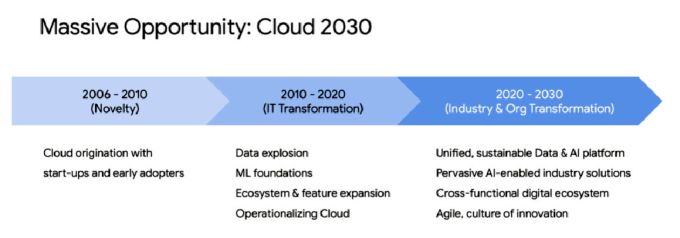

Que la estrategia de Thomas Kurian, en su tercer año desde que fue fichado como CEO de Google Cloud es el crecimiento, no tiene misterio. La ha explicado didácticamente describiendo las tres fases sucesivas de la evolución de la nube. La primera, apoyada en el desarrollo de aplicaciones SaaS, sentó las bases de un ecosistema que fructificaría a partir de 2010 en una suerte de selección natural que hizo eclosionar startups y que otros jugadores se retiraran de la partida. El punto de inflexión, siempre según Kurian, ha sido 2020: inicio de un nuevo ciclo dominado por plataformas de datos y por la introducción de IA en las soluciones industriales. El esquema que mostró en pantalla fue el siguiente:

Como se ve, la secuencia conduce a dar relieve a la especialización de GCP en soluciones verticales, con una creciente contribución de la Inteligencia Artificial. Es innecesario recordar lo que todos saben, que la IA es una de las fortalezas de Google; por otra parte, la digitalización sectorial tampoco es nueva en el discurso de Kurian, que la viene proclamando desde el día de su desembarco procedente de Oracle, donde preconizaba parecidas ideas. No es nuevo el discurso, pero toca pisar el acelerador, porque el mundo está en trance de profundo cambio tras la pesadilla de la Covid-19.

La premisa de Kurian dice que ningún sector es inmune a las fuerzas de la digitalización, que a su vez presionan sobre la capacidad de innovación de los proveedores de la nube. Además de intenciones, Kurian también tiene un método: aprovechar las muchas soluciones transversales con las que cuenta en el acervo de Google para penetrar con ellas en determinadas industrias que, en virtud de sus inercias, no han prestado una atención suficiente a las TI. Pero que sí tienen necesidades específicas como la gobernanza de los datos, el cumplimiento de una jungla de normativas y el gran reto por delante, la seguridad.

Avanzar en esa dirección supondrá ir creando conjuntos de soluciones para determinados sectores; en especial, dar rienda suelta a la capacidad que Google tiene bien acreditada en machine learning y asimismo apuntar a la experiencia del cliente (CX) argumento este último que hará pesar en sus clientes del sector financiero a los que propondrá un artefacto que ha sido provisionalmente entendido como nubes a la carta.

Un aspecto central expuesto por Kurian en la conferencia Data Cloud Summit ha sido la consolidación del ecosistema de partners con líneas más claras, ya se trate de proveedores de datos, vendedores de software o desarrolladores de soluciones.

Durante el evento, Google Cloud presentó la herramienta I/O Vertex AI, una plataforma de aprendizaje automático con la que espera que los desarrolladores encuentren más fácil implementar y mantener sus modelos de IA, como ya lo han intentado AWS con SageMaker y Microsoft con Azure ML.

Es reseñable la aparición en público de Lori Mitchell-Keller, vicepresidenta global de soluciones verticales. Ha abandonado hace poco SAP, donde transcurrió casi toda su carrera profesional, para subirse al barco de Google; dijo alto y claro que no ha cambiado de empleador para que GCP se convierta en otro proveedor transaccional.

Sin embargo, una cosa es no entrar en guerra con las compañías de TI (SAP, Oracle o Microsoft) y otra limitarse a ser un mero suministrador de tecnologías de IA, big data y machine learning para que otros se lleven la cosecha. Según dijo Miichell-Keller, Google Cloud pretende erigirse como actor relevante en el cambio cultural que inevitablemente tiene que abordar la industria en relación con los datos.

En este punto, intervino otro fichaje reciente. Gerrit Kazmaier asumió en abril la dirección general – con rango de vicepresidente – de Análisis de Datos, Bases de Datos y Looker [plataforma de Business Intelligence de Google Cloud]. Recomendó que, en lugar de pensar en los datos desde una visión tecnológica, hay que poner el centro en la capacidad. Lo dice alguien que durante seis años en SAP ha ocupado responsabilidades en la faceta de analytics de la multinacional alemana.

Con las novedades presentadas en la conferencia, esta rama de Google ha evidenciado su aspiración de llegar a conectar el ciclo de vida completo de los datos. Desde donde se ejecutan las aplicaciones hasta los sistemas analíticos donde son reconocidos los patrones, pasando por el aprendizaje automático que ayude a la predicción, acabando en la toma de decisiones. Tras este ciclo de vida de los datos hay una serie de roles empresariales – en las compañías de cierto tamaño, claro está – y GCP se atrincheraría en un papel transversal. El objetivo declarado es una plataforma de datos unificada.

Otra de las bazas con las que juega Google Cloud es su tecnología para el procesamiento de lenguaje natural (NLP), en la que cree encontrarse por delante de otros actores del mercado. Su combinación con la IA a escala comercial puede dar un salto cualitativo si se suma a la categoría RPA (Robotic Process Automation) en la que la compañía está explorando alianzas.

Según Kazmaier, casi toda empresa que se precie cree reconocerse como data-driven, pero menos de una tercera parte (fuente: McKinsey) son capaces de atribuir un valor a los datos que poseen. Por ahí van los tiros: “es necesario conectar los diferentes roles de quienes trabajan con datos – dijo – para que lo hagan sobre una plataforma común para que generen valor cuantificable”.

Junto a Vertex AI, otros productos presentados, pero todavía no en fase comercial, apuntan en esa dirección. De Dataplex se espera que sirva a las organizaciones para gestionar, monitorizar y gobernar con un punto de vista único los datos contenidos bajo distintas formas: data lakes, data warehouses y databases, tanto si residen on-premise o en entornos cloud.

Cada uno de estos sistemas tienen su propia manera de manejar los metadatos, la calidad y seguridad de los datos que alberga, al tiempo que los usos de técnicas analíticas se dispersan sin concierto dentro de las organizaciones.

A este problema viene a responder en parte DataStream, un servicio para soporte multicloud, desarrollado dentro de Google con la finalidad de facilitar la ingesta en tiempo real de datos que se encuentran en bases de datos dispersas de distinta naturaleza y proveedor.

Se dio a conocer Analytics Hub, servicio gestionado sobre BigQuery que debería permitir el intercambio y compartición de los datos y sus activos analíticos a través de organizaciones diferentes. O nubes diferentes.

En esencia, se trata de hacer de Google Cloud una nube de datos lo más abierta posible, con un ecosistema de partners en consonancia. Kurian aportó un dato que puede servir de colofón: en 2020, los clientes de GCP analizaron un 200% más de datos a escala de exabytes, utilizando las técnicas desarrolladas por Google.

[informe de David Bollero]